文章信息

基金项目

- 广东省农业科学院协同创新中心项目(XT202203);农业农村部重点实验室开放课题(2011NYZD2205);广东省乡村振兴战略专项资金-设施智慧水产专家工作站(2023工作站10);广东省乡村振兴战略专项(农业科技能力提升)(2023TS-1-3)

作者简介

- 罗毅智(1995—),男,博士,助理研究员,研究方向为智慧农业装备、渔业多源信息获取和融合技术、基于多模态技术的动物行为分析,E-mail:yizhi_luo@yeah.net.

通讯作者

- 周星星(1987—),男,博士,研究员,研究方向为智慧农业、智能农业装备与果园机械化,E-mail:zhouxingxing@gdaas.cn.

文章历史

- 收稿日期:2023-05-27

2. 广东省农业科学院动物科学研究所(水产研究所),广东 广州 510645;

3. 农业农村部设施农业装备与信息化重点实验室,浙江 杭州 311000;

4. 广东省农业科学院,广东 广州 510640

2. Institute of Animal Science (Fisheries Research Institute), Guangdong Academy of Agricultural Sciences, Guangzhou 510645, China;

3. Key Laboratory of Equipment and Informatization in Environment Controlled Agriculture, Ministry of Agriculture and Rural Affairs, Hangzhou 311000, China;

4. Guangdong Academy of Agricultural Sciences, Guangzhou 510640, China

【研究意义】近年来,随着对动物蛋白需求的不断增加和传统渔业资源的严重减少,渔业正逐步向水产设施养殖转型[1-4]。其中,网箱生物识别是海洋牧场的关键作业流程之一。由于网箱养殖局部密度大、水体透光率不足,视觉成像效果不佳,大大影响智能渔场的作业效率[5-6]。浑浊水中悬浮颗粒可导致图像对比度低、模糊和失真[7],尽管光学成像类型的相机提供了高分辨率图像,但未知的成像条件,包括光学水类型、场景位置以及海洋介质的吸收和散射特性,对光信息的传输有重大影响,进而导致严重的图像失真[8]。考虑到光学传感器在水下场景中的客观局限性,浑浊水体成像检测方法常利用非光学传感器,如激光雷达、声呐等[6, 9-14]。声呐系统根据声波发射和回收的计算过程获得图像,其中发射的声波在遇到目标物体后会被反射和接收。因此,接收到的回波包含不同物体显著的声波吸收特性。由于水声通道的复杂性和声波散射的多变性,接收到的回波中还混杂着环境噪声、混响和声呐自噪声等干扰,对声呐图像的准确目标检测提出重大挑战。

【前人研究进展】传统的目标检测方法手动提取目标区域的特征,通常使用一定大小的帧作为滑动窗口来遍历整个图像,称为“锚点”。通过设置不同的长宽比和尺寸,采用穷举方法确定目标,导致模型耗时长、鲁棒性差[15-17]。近年来,随着计算机技术的发展,以深度学习为代表的技术在水下图像除雾和目标识别领域得到广泛应用[18-19]。Liu等[20]利用图像处理和深度学习相结合的方式,实现海洋生物的物种识别和密度计算,该模型主要解决了非均匀光场下生物图像的特征优化问题。邓步等[21]提出一种基于声呐信息融合的水下图像增强模型,该模型采用去雾技术,显著提高检测目标的对比度。刘承峰等[22]采用了一种基于多尺度卷积核双端注意力机制融合的模型,该模型采用多尺度卷积滤波算子,构造多分辨率卷积神经网络,进一步提高水下小目标的检测精度。此外目标检测的主流算法可大致分为两阶段检测模型和单阶段检测模型两种类型。其中基于区域卷积神经网络(Faster Regions with CNN features,Faster RCNN)引入区域生成网络(Region Proposal Network,RPN),该模型提取输入图像的特征,同时生成候选区域,避免重复提取特征图,同RCNN相比,降低了模型的计算复杂度,提高了目标检测的速度和精度[23]。单阶段检测模型将目标检测定义为“一步完成”,同时完成目标分类、定位以及检测,在精度上,两阶段检测模型要优于单阶段检测模型;在速度上,单阶段模型实时性更强[24]。YOLO系列模型被认为目标检测领域的里程碑。科研人员在YOLO模型基础上进行了系列改进,提出YOLOV2、YOLOV3以及YOLOV4版本等,进一步提高了模型的检测精度,同时保持了模型的实时性。与Faster RCNN不同,YOLO系列将目标检测作为一个回归问题,直接得出检测对象的位置、类别以及置信度。有效的目标特征检测器和分类器为深度学习方法提供了在浑浊水环境中的优势[25-26]。此外,偏振成像技术通过深入挖掘散射光场中偏振信息的独特性和差异性,在去除背景散射光和获得清晰的水下图像方面具有明显优势,该方法利用入射偏振光的偏振特性,可以分离场景中的这两种光,有效还原清晰的场景,提高成像结果的对比度和清晰度,辅助水下目标的检测和识别[27]。

【本研究切入点】综上所述,环境噪声、混响和声呐自噪声为对水下声鱼类检测的主要难点之一,对目标检测模型的网络结构进行优化可以大幅度提高检测精度,截至目前,很少学者研究兼容鱼类检测精度和轻量化模型。【拟解决的关键问题】本文以罗非鱼为研究对象,通过比较不同水下成像方式的优缺点,采用一种前视声呐声学成像技术,提出一种轻量级的鱼类识别网络(LAPR-Net,Lightweight Aquatic product Recognition Network), 实现浑浊水体下的鱼类检测。

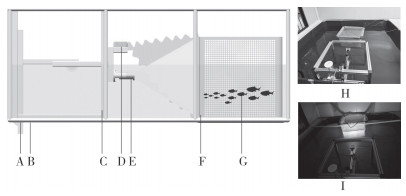

1 材料与方法 1.1 试验条件试验周期为2022年9—11月。如图 1所示,浑浊场景鱼类识别平台包含帆布池(长×宽×高=2.0 m×2.0 m×0.8 m)、多源信息采集平台、网箱(长×宽×高= 0.6 m×0.6 m×0.6 m)。其中,多源信息采集平台包含机械结构、水下摄像头、录像机、声呐以及声呐数据采集器。

|

| A:出水管道;B:帆布池;C:多源采集系统机械结构;D:前视声呐;E:水下摄像头;F:网箱;G:鱼类;H:白天作业场景;I:夜晚作业场景 A: Outlet pipeline; B. Canvas pool; C: Mechanical structure of multi-source acquisition system; D: Forward-looking sonar; E: Underwater camera; F: Cage; G: Fish; H: Daytime operation scene; I: Night operation scene 图 1 试验场景示意图 Fig. 1 Schematic diagram of the test scene |

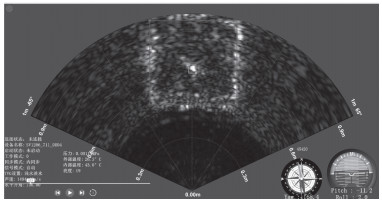

多源数据集由水下摄像头(霸勒思,E5MP3CX10)和前视声呐(珠海蓝衡科技有限公司,1206D)记录如图 2所示。相机的底部固定在铝型材上,为捕捉网箱以及鱼群(网箱鱼群数量n=6),相机镜头逆时针向上倾斜10°。视频同时记录并存储在硬盘,声呐数据集存储于声呐数据采集器。此外,声呐的声速为1 493.84 m/s,压力约为0.0015 Mpa,声呐采集视角设置为130°。

|

| 图 2 检测模型数据标注实例 Fig. 2 Data labeling instances of detection model |

1.2 数据集构建

为提高模型的泛化能力与鲁棒性,将全天视频文件(.DB)转化为MP4视频,分离出不同时段的图像数据2 004张,经图像翻转、对比度调整以及亮度调整后,最终浑浊场景鱼类识别数据集(WR-dataset)扩增至6 012张,其中训练集和验证集5 400张、测试集612张。采用开源交互式标记工具Labelme进行标注,标注类别共有两个,红色框代表网箱,绿色框代表鱼类。为减少人为标记误差,标记时2人1组,标记过程中如果对图像标记的结果不确定,则将图像从数据集中删除;最后,以MSCOCO格式保存为JSON文件。

1.3 网络框架针对混响噪声和复杂背景的干扰造成鱼类难以检测的问题,本文提出一种改进的YOLOV5深度学习模型,实现浑浊水体下鱼类检测。YOLOV5采用共享卷积核的方式,减少计算次数,降低模型参数量,提高网络计算效率。模型架构如图 2所示,主要由3部分组成,包含主干特征提取网络、颈部网络以及预测头[28]。

(1)主干特征提取网络:如图 3A所示,沿用YOLOV5S的网络结构,图片进入模型后经过切片后进行卷积操作,主体结构采用MobileNetV3 bneck块(淡蓝色模块),不同于VGG、Resnet、ViT等网络模型,MobileNet参数少、计算快。如图 3E所示,以MobileNetV3-Large的网络结构为例,模型使用非线性激活函数h-swish,将第一层卷积核的数量修改为16个3×3卷积,进一步降低模型参数量,模型的网络配置见图 3E。此外,在block基础上引入通道注意力机制(Squeeze-and-Excitation,SEnet)模块,利用注意力模块,提高对鱼类特征的捕获能力,如图 3D所示。一方面,该模块增强了图像的局部信息特征的提取能力,另一方面,充分利用上下文信息,提高了网箱和鱼的特征提取能力。

|

| 图 3 LFR-Net网络框架 Fig. 3 LFR-Net Network framework |

(2)颈部网络:如图 3B所示,颈部网络常用于特征图融合,优化特征表达能力,本文模型采用路径聚合网络结构(Path Aggregation Network,PANet),其最早用于图像分割领域,例如,以输入图像尺寸(1 920×1 920像素)为例,经过主干网络后分别获取4种不同尺度的特征图(240×240、120×120、60×60、30×30像素),经过上采样和连接层后,用于检测不同大小的目标,进一步缓解鱼类目标检测精度不高的问题, 增强特征融合能力。

(3)预测头:预测头是检测器的预测部分,用于输出图像中鱼类的位置和置信度,如图 3C所示。基于非极大抑制方法进行最大局部搜索,去除冗余的检测框,筛选置信度最高的检测框,最终输出并显示目标检测结果,包含位置、类别以及检测目标的概率。

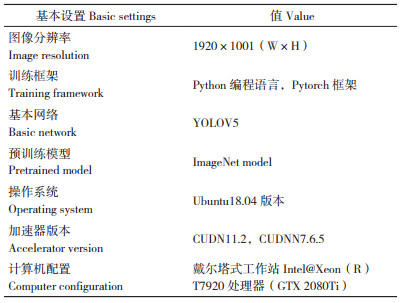

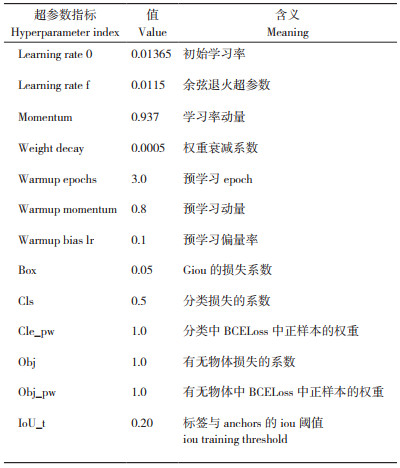

2 结果与分析 2.1 模型训练和评价指标试验平台训练环境的基本设置如表 1所示。训练过程采用迁移学习的方式进行,模型加载ImageNet的预训练权重进行微调,模型的超参数设置值见表 2。为验证改进模型的有效性及改进模型的检测效果,采用4种不同骨干网络进行对比试验[29-32]。

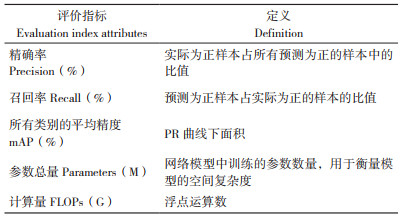

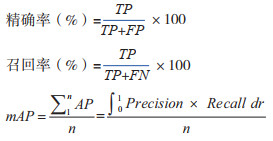

如表 3所示,模型的评价指标包含精确率、召回率、平均精度及F1分数[33-34],其计算公式如下:

|

式中,TP(True Positive)为IOU > IOU阈值的检测框数(IOU阈值=0.5);FP(False Positive)为IOU < = IOU阈值(IOU阈值=0.5)的检测框数;FN(False Negative)为未检测到GT的数量,GT为手工标注的外接矩形(标签);n为类别,AP为平均精确度。

此外,本文使用第三方Thop库中的Pofile函数对模型参数量和模型计算量进行计算。Profile函数实现机制是利用PyTorch中的注册模块前钩(Register_forward_hook),为所有模块注册一个全局前向钩子。

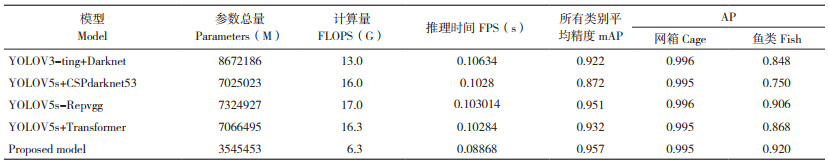

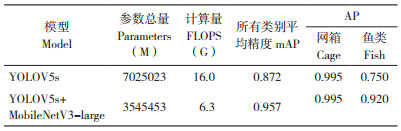

2.2 不同模型的试验结果本文选择4种其他模型进行对比试验,包含YOLOV3-ting(Darknet53)、YOLOV5(CSPdarknet53)、YOLOV5(Repvgg)、YOLOV5s(Transformer)。训练轮数是300 Epoch,模型训练的超参数见表 2。对比结果如表 4所示,本模型的参数量最少、计算量最少,与YOLOV5模型相比,改进后模型mAP提高9.7%,推理数据集随机抽取50张图片,本模型平均每张图片推理速度为0.08868 s。

各模型训练过程的评价指标,包括精确度、召回率以及mAP0.5的趋势图如图 4所示,在精确度、召回率和mAP的趋势图中,所有模型趋势基本在epoch=180稳定,后续可以缩减训练轮数、加快训练进度。此外,本文提出的模型评价指标均优于其他模型,在参数总量和计算量减少下,mAP为0.957,模型消融实验结果见表 5。

|

| A: 精确度;B: 召回率;C: 所有类别平均精度 A: Precision; B: Recall; C: mAP 图 4 不同模型训练过程 Fig. 4 Training process of different models |

图 5展示了网箱和鱼类检测实例,图 5A、C为正确识别的实例,但由于姿态和噪声,模型存在假阳性案例(图 5D),图像显示有两个检测框,后续可以提高冗余框筛选的阈值。另一现象表明,在网箱边缘识别效果不佳,鱼在网箱附近时,受噪声干扰影响,易错误识别为鱼(图 5B)。

|

| A、C为正确识别,B、D为错误识别 A and C represent correct identificatien, B and D represent misidentification 图 5 LAPR-Net模型检测实例 Fig. 5 Detection instances of LAPR-Net model |

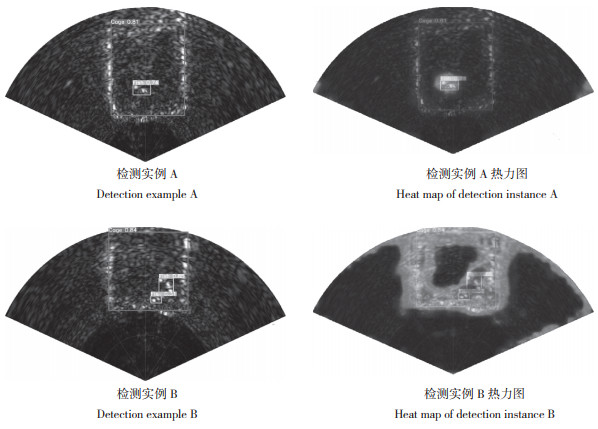

2.3 类激活图可视化分析

为更好地理解基于所提出改进模型的学习能力,选取模型的类激活图进行解释,本文结合GradCAM热力图可视化,可视化的部分结果如图 6所示[35]。可以发现,不同的特征图激活不同区域,如鱼所在的区域、鱼的背景。此外,由于识别的对象颜色和背景相似,网箱的轮廓边缘部分也被激活,后续在声信号转声呐图像过程中,可更换不同的颜色背景,提高模型的识别精度。

|

| 图 6 不同卷积层热力图分析 Fig. 6 Thermodynamic diagram analysis of different convolutional layers |

3 讨论

近年来,随着对动物蛋白需求的不断增加和传统渔业资源的严重减少,渔业正逐步向水产设施养殖转型。其中,网箱生物识别是海洋牧场的关键作业流程之一。考虑到光学传感器在水下场景中的客观局限性,浑浊水体成像方法常利用非光学传感器,如激光雷达、声呐等,该方式有助于对结构复杂、浑浊黑暗的水下环境进行目标识别和计数。但是该类型设备成像分辨率低,易受运动载体和环境噪声影响,计算量较大[36]。本文采用前视声纳技术,提出一种轻量级的鱼类识别模型(LAPR-Net),实现浑浊或黑暗场景下水体鱼类识别。

相比于传统的机器视觉方法,利用基于人工设计特征,获取目标的位置信息,本文提出的模型可以自动提取目标特征,主干网络模块采用轻量级MobileNetV3 benck块,利用线性瓶颈的逆残差结构和深度可分离卷积提取声呐图像中鱼类的特征,通过注意力机制SE-Net来获取声纳图像多尺度语义特征并增强特征之间的相关性,本文选择4种其他模型进行对比试验,包含YOLOV3- ting(Darknet53)、YOLOV5(CSPdarknet53)、YOLOV5(Repvgg)、YOLOV5s(Transformer),试验结果显示, 本文提出的模型的参数量最少(3 545 453 M)、计算量最少(6.3 G),同YOLOV5模型相比,改进后模型mAP提高9.7%,为后续浑浊或者黑暗场景下鱼类检测模型部署提供参考。

此外,受网箱和水流振动产生噪声的影响,小目标易错误识别为噪声。随着设备算力的提高,以深度学习为代表的技术逐渐成为水产养殖识别研究的新方式,可以加快图像的处理效率,可推动多模态图像融合在水产领域的应用前景[37],结合不同类型的相机,利用信息融合技术实现水下动物多类型数据信息融合,在远距离范围,采用声呐信息,近距离或者小型鱼,采用光学相机,提高小型鱼的检测精度[38]。

4 结论近年来,混响噪声和复杂背景的干扰是鱼类难以检测的问题的关键。本文提出了一种轻量级的鱼类识别模型(LAPR-Net),实现浑浊水体下鱼类检测。该模型在YOLOV5模型基础上,主体结构采用MobileNetV3 benck块,利用线性瓶颈的逆残差结构和深度可分离卷积提取声呐图像中鱼类的特征,通过注意力机制SE-Net来获取声纳图像多尺度语义特征并增强特征之间的相关性。同YOLOV5模型相比,改进后模型mAP提高9.7%,模型参数量为3 545 453 M、计算量为6.3 G,对于海洋牧场智慧养殖提供鱼类检测方案。

| [1] |

莽琦, 徐钢春, 朱健, 徐跑. 中国水产养殖发展现状与前景展望[J]. 渔业现代化, 2022, 49(2): 1-9. DOI:10.3969/j.issn.1007-9580.2022.02.001 MANG Q, XU G C, ZHU J, XU P. Developmental status and prospective vision for China's aquaculture[J]. Fishery Modernization, 2022, 49(2): 1-9. DOI:10.3969/j.issn.1007-9580.2022.02.001 |

| [2] |

WEI Y G, WEI Q, AN D. Intelligent monitoring and control technologies of open sea cage culture: A review[J]. Computers and Electronics in Agriculture, 2020, 169: 105119. DOI:10.1016/j.compag.2019.105119 |

| [3] |

曹守启, 周礼馨, 张铮. 采用改进长短时记忆神经网络的水产养殖溶解氧预测模型[J]. 农业工程学报, 2021, 37(14): 235-242. DOI:10.11975/j.issn.1002-6819.2021.14.027 CAO S Q, ZHOU L X, ZHANG Z. Prediction model of dissolved oxygen in aquaculture based on improved long short-term memory neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(14): 235-242. DOI:10.11975/j.issn.1002-6819.2021.14.027 |

| [4] |

田晔, 肖润国, 裴洛伟, 叶章颖, 朱松明, 刘鹰, 郭建林, 王朔. 循环水养殖水处理系统中UVC-LED光反应器的CFD模拟及优化[J]. 农业工程学报, 2022, 38(1): 258-265. DOI:10.11975/j.issn.1002-6819.2022.01.029 TIAN Y, XIAO R G, PEI L W, YE Z Y, ZHU S M, LIU Y, GUO J L, WANG S. CFD simulation and optimization of the UVC-LED reactor in aquaculture water treatment system[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(1): 258-265. DOI:10.11975/j.issn.1002-6819.2022.01.029 |

| [5] |

庄保陆, 张宇雷, 倪琦, 叶章颖, 刘晃. 格栅和光色对黑鲷穿梭与群聚行为的影响[J]. 渔业现代化, 2019, 46(6): 40-47. DOI:10.3969/j.issn.1007-9580.2019.06.007 ZHUANG B L, ZHANG Y L, NI Q, YE Z Y. Effect of grilles and light colors on the shuttle and congregation behavior of Acanthopagrus schlegeli[J]. Fishery Modernization, 2019, 46(6): 40-47. DOI:10.3969/j.issn.1007-9580.2019.06.007 |

| [6] |

荆丹翔, 韩军, 王杰英, 王晓丁, 徐志伟. 基于成像声呐的鱼类三维空间分布[J]. 水产学报, 2018, 42(6): 996-1005. DOI:10.11964/jfc.20170510831 JING D X, HAN J, WANG J Y, WANG X D, XU Z W. Three-dimensional distribution of fish using an imaging sonar[J]. Journal of Fisheries of China, 2018, 42(6): 996-1005. DOI:10.11964/jfc.20170510831 |

| [7] |

YANG X L, YIN C Y, ZHANG Z Y, LI Y P, LIANG W F, WANG D, TANG Y D, FAN H J. Robust chromatic adaptation based color correction technology for underwater images[J]. Applied Sciences, 2020, 10(18): 6392. DOI:10.3390/app10186392 |

| [8] |

UBINA N M A, CHHENG S C, CHANG C C, CAI S Y, LAN H Y. Intelligent underwater stereo camera design for fish metric estimation using reliable object matching[J]. IEEE Access, 2022, 10: 74605-74619. DOI:10.1109/ACCESS.2022.3185753 |

| [9] |

XIN Y, GUO L X, LUO C, ZHOU X T, YU C L. A survey of target detection and recognition methods in underwater turbid areas[J]. Applied Sciences, 2022, 12(10): 4898. DOI:10.3390/app12104898 |

| [10] |

檀盼龙, 吴小兵, 张晓宇. 基于声呐图像的水下目标识别研究综述[J]. 数字海洋与水下攻防, 2022, 5(4): 342-353. DOI:10.19838/j.issn.2096-5753.2022.04.010 TAN P L, WU X B, ZHANG X Y. Review on underwater target recognition based on sonar image[J]. Digital Ocean & Underwater Warfare, 2022, 5(4): 342-353. DOI:10.19838/j.issn.2096-5753.2022.04.010 |

| [11] |

淦智权. 基于无监督学习卷积神经网络的声呐图像分割[J]. 数字海洋与水下攻防, 2022, 5(4): 381-386. DOI:10.19838/j.issn.2096-5753.2022.04.015 GAN Z Q. Sonar images segmentation based on unsupervised convolutional neural network[J]. Digital Ocean & Underwater Warfare, 2022, 5(4): 381-386. DOI:10.19838/j.issn.2096-5753.2022.04.015 |

| [12] |

高晗, 刘卫东, 高立娥. 基于前视声呐的水下目标检测算法研究[J]. 计算机测量与控制, 2022, 30(11): 17-24. DOI:10.16526/j.cnki.11-4762/tp.2022.11.003 GAO H, LIU W D, GAO L E. Research on underwater target detection algorithm based on forward looking sonar[J]. Computer Measurement & Control, 2022, 30(11): 17-24. DOI:10.16526/j.cnki.11-4762/tp.2022.11.003 |

| [13] |

黄鹏. 基于深度学习的前视声呐图像配准研究[D]. 杭州: 杭州电子科技大学, 2022. DOI: 10.27075/d.cnki.ghzdc.2022.000898. HUANG P. Research on forward-looking sonar image registration based on deep learning[D]. Hangzhou: Hangzhou Dianzi University, 2022. DOI: 10.27075/d.cnki.ghzdc.2022.000898. |

| [14] |

王凯, 秦丽萍, 卢丙举, 侯冬冬, 经慧祥. 大噪声环境下前视声呐图像目标识别方法研究[J]. 舰船科学技术, 2022, 44(1): 125-130. DOI:10.3404/j.issn.1672-7649.2022.01.024 WANG K, QIN L P, LU B J, HOU D D, JING H X. Research on target recognition method of forward looking sonar image in large noise environment[J]. Ship Science and Technology, 2022, 44(1): 125-130. DOI:10.3404/j.issn.1672-7649.2022.01.024 |

| [15] |

叶章颖, 赵建, 朱松明, 刘鹰. 基于鱼群行为的循环水养殖游泳型鱼类高效投喂方法研究[C]. 2016年中国水产学会学术年会, 中国成都, 2016. YE Z Y, JHAO Z, ZHU S M, LIU Y. Behaviors-based study of the efficient feeding methods of swimming fishes in recirculating aquacultural systems[C]. 20l6. |

| [16] |

赵建, 张丰登, 杭晟煜, 朱松明, 叶章颖. 基于计算机视觉和深度学习的鱼群局部异常行为监测[C]. 2018年中国水产学会学术年会, 西安, 2018. ZHAO J, ZHANG F D, HANG S Y, ZHU S M, YE Z Y. Computer vision and deep learning-based monitoring of the local unusual behaviors for fish school in intensive aquaculture[C]. Xi'an, 2018. |

| [17] |

赵建, 朱松明, 叶章颖, 刘鹰, 李勇, 卢焕达. 循环水养殖游泳型鱼类摄食活动强度评估方法研究[J]. 农业机械学报, 2016, 47(8): 288-293. DOI:10.6041/j.issn.1000-1298.2016.08.038 ZHAO J, ZHU S M, YE Z Y, LIU Y, LI Y, LU H D. Assessing method for feeding activity of swimming fishes in RAS[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(8): 288-293. DOI:10.6041/j.issn.1000-1298.2016.08.038 |

| [18] |

蔡卫明, 庞海通, 张一涛, 赵建, 叶章颖. 基于卷积神经网络的养殖鱼类品种识别模型[J]. 水产学报, 2022, 46(8): 1369-1376. DOI:10.11964/jfc.20201212529 CAI W M, PANG H T, ZHANG Y T, ZHAO J, YE Z Y. Recognition model of farmed fish species based on convolutional neural network[J]. Journal of Fisheries of China, 2022, 46(8): 1369-1376. DOI:10.11964/jfc.20201212529 |

| [19] |

赵华民, LAWAL OLAREWAJU, 许德芳. 温室甜瓜自动采摘系统目标检测模型及空间定位研究[J]. 广东农业科学, 2022, 49(3): 151-162. DOI:10.16768/j.issn.1004-874X.2022.03.017 ZHAO H M, LAWAL O, XU D F. Study on target detection model and spatial location of greenhouse muskmelon automatic picking system[J]. Guangdong Agricultural Sciences, 2022, 49(3): 151-162. DOI:10.16768/j.issn.1004-874X.2022.03.017 |

| [20] |

LIU Y, WEI M, ZONG H. Jellyfish recognition and density calculation based on image processing and deep learning[C]. IEEE, 2020, 922-927. DOI: 10.1109/CCDC49329.2020.9164388.

|

| [21] |

邓步, 李弘毅, 顾亚平. 一种基于声呐信息融合的水下图像增强方法[J]. 声学技术, 2023, 42(1): 106-112. DOI:10.16300/j.cnki.1000-3630.2023.01.018 DENG B, LI H Y, GU Y P. An underwater image enhancement method based on sonar information fusion[J]. Technical Acoustics, 2023, 42(1): 106-112. DOI:10.16300/j.cnki.1000-3630.2023.01.018 |

| [22] |

刘承伟, 洪峰, 冯海泓, 胡梦璐. 结合多尺度卷积网络和双端注意力机制的水声目标识别[J]. 声学技术, 2023, 42(2): 161-167. DOI:10.16300/j.cnki.1000-3630.2023.02.006 LIU C W, HONG F, FENG H H, HU M L. Underwater acoustic target recognition based on dual attention networks and multiresolution convolutional neural networks[J]. Technical Acoustics, 2023, 42(2): 161-167. DOI:10.16300/j.cnki.1000-3630.2023.02.006 |

| [23] |

LUO Y Z, ZENG Z X, LU H Z, LV E L. Posture detection of individual pigs based on lightweight convolution neural networks and efficient channel-wise attention[J]. Sensors, 2021, 21(24): 8369. DOI:10.3390/s21248369 |

| [24] |

王海漫, 俞婷, 肖明明, 杨嘉诚, 陈富荣, 易干军, 林德球, 罗敏. 基于改进YOLOX模型的柑橘木虱检测方法[J]. 广东农业科学, 2022, 49(11): 43-49. DOI:10.16768/j.issn.1004-874X.2022.11.005 WANG H M, YU T, XIAO M M, YANG J C, CHEN F R, YI G J, LIN D Q, LUO M. Detection of citrus psyllid based on improved YOLOX model[J]. Guangdong Agricultural Sciences, 2022, 49(11): 43-49. DOI:10.16768/j.issn.1004-874X.2022.11.005 |

| [25] |

TIAN G L, LI D L, LI W S, LU Z, ZhANG H X, DUAN Q L. A detection method of the turned white belly fish based on improved SSD[J]. Journal of Physics Conference Series, 2021, 1856(1): 12035. DOI:10.1088/1742-6596/1856/1/012035 |

| [26] |

王宏乐, 王兴林, 李文波, 邹阿配, 叶全洲, 刘大存. 一种基于解耦旋转锚框匹配策略的谷粒检测方法[J]. 广东农业科学, 2022, 49(12): 143-150. DOI:10.16768/j.issn.1004-874X.2022.12.016 WANG H L, WANG X L, LI W B, ZOU A P, YE Q Z, LIU D C. A rice grain detection method based on rotation-decoupled detector for oriented object[J]. Guangdong Agricultural Sciences, 2022, 49(12): 143-150. DOI:10.16768/j.issn.1004-874X.2022.12.016 |

| [27] |

王昊月, 陈向宁, 徐碧洁, 杜姝函, 李轶南. 不同光照条件下浑浊水体中目标物偏振成像效果研究[J]. 光学技术, 2022, 48(4): 398-402. DOI:10.13741/j.cnki.11-1879/o4.2022.04.017 WANG H Y, CHEN X N, XU B J, DU S H, LI Y N. Polarisation imaging of targets in turbid water under different lighting conditions[J]. Optical Tecchnique, 2022, 48(4): 398-402. DOI:10.13741/j.cnki.11-1879/o4.2022.04.017 |

| [28] |

MEKHALFI M L, NICOLO C, BAZI Y, MOHAMAD M A R L, NORAH A A, ESLAM A M. Contrasting YOLOv5, transformer, and efficientdet detectors for crop circle detection in desert[J]. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 1-5. DOI:10.1109/LGRS.2021.3085139 |

| [29] |

ZHANG L, WANG J, LI B B, LIU Y R, ZHANG H X, DUAN Q L. A MobileNetV2-SENet-based method for identifying fish school feeding behavior[J]. Aquacultural Engineering, 2022, 99: 102288. DOI:10.1016/j.aquaeng.2022.102288 |

| [30] |

朱明, 张镇府, 黄凰, 陈燕燕, 刘亚东, 董涛. 基于轻量级神经网络MobileNetV3-Small的鲈鱼摄食状态分类[J]. 农业工程学报, 2021, 37(19): 165-172. DOI:10.11975/j.issn.1002-6819.2021.19.019 ZHU M, ZHANG Z F, HUANG H, CHEN Y Y, LIU Y D, DONG T. Classification of perch ingesting condition using lightweight neural network MobileNetV3-Small[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(19): 165-172. DOI:10.11975/j.issn.1002-6819.2021.19.019 |

| [31] |

张璐, 黄琳, 李备备, 陈鑫, 段青玲. 基于多尺度融合与无锚点YOLO v3的鱼群计数方法[J]. 农业机械学报, 2021, 52(S1): 237-244. DOI:10.6041/j.issn.1000-1298.2021.S0.029 ZHANG L, HUANG L, LI B B, CHEN X, DUAN Q L. Fish school counting method based on multi-scale fusion and no Anchor YOLOv3[J]. Transactions of the Chinese Society for Agricultural Machinery, 2021, 52(S1): 237-244. DOI:10.6041/j.issn.1000-1298.2021.S0.029 |

| [32] |

CHEN C, ZHU W, OCZAK M, KRISTINA M, JOHHANNNES B, LARSEN M L V, NORTON T. A computer vision approach for recognition of the engagement of pigs with different enrichment objects[J]. Computers and Electronics in Agriculture, 2020, 175: 105580. DOI:10.1016/j.compag.2020.105580 |

| [33] |

ZHANG L, ZHOU X H, LI B B, ZHANG H X. Automatic shrimp counting method using local images and lightweight YOLOv4[J]. Biosystems Engineering, 2022, 220: 39-54. DOI:10.1016/j.biosystemseng.2022.05.011 |

| [34] |

LIU C, GU B, SUN C, LI D L. Effects of aquaponic system on fish locomotion by image-based YOLO v4 deep learning algorithm[J]. Computers and Electronics in Agriculture, 2022, 194: 106785. DOI:10.1016/j.compag.2022.106785 |

| [35] |

ZHAO B, LI P, DAI M R. Visualization of railway scene classification model via Grad-CAM, 2018[C]. IEEE, 2018. DOI: 10.1109/SIPROCESS.2018.8600437.

|

| [36] |

张涵钰, 李振波, 李蔚然, 杨普. 基于机器视觉的水产养殖计数研究综述[J]. 计算机应用, 1-13[2023-09-04]. DOI: 10.11772/j.issn.1001-9081.2022081261. ZHANG H Y, LI Z B, LI W R, YANG P. Review of research on aquaculture counting based on machine vision[J]. Journal of Computer Applications, 1-13[2023-09-04]. DOI: 10.11772/j.issn.1001-9081.2022081261. |

| [37] |

张小花, 马瑞峻, 吴卓葵, 黄泽鸿, 王嘉辉. 基于机器视觉的果园成熟柑橘快速识别及产量预估研究[J]. 广东农业科学, 2019, 46(7): 156-161. DOI:10.16768/j.issn.1004-874X.2019.07.022 ZHANG X H, MA R J, WU Z K, HUANG Z H, WANG J H. Fast detection and yield estimation of ripe citrus fruit based on machine vision[J]. Guangdong Agricultural Sciences, 2019, 46(7): 156-161. DOI:10.16768/j.issn.1004-874X.2019.07.022 |

| [38] |

许莎莎, 李文彬, 康峰. 激光雷达和摄像机联合标定识别作物[J]. 广东农业科学, 2014, 41(24): 161-165, 178. DOI:10.16768/j.issn.1004-874x.2014.24.039 XU S S, LI W B, KANG F. Crop recognition by combined calibration of laser radar and camera[J]. Guangdong Agricultural Sciences, 2014, 41(24): 161-165, 178. DOI:10.16768/j.issn.1004-874x.2014.24.039 |

(责任编辑 白雪娜)

2023, Vol. 50

2023, Vol. 50